Domotica 2026: HomePod e lo Sguardo Che Guida

L’interazione con gli assistenti vocali ha segnato un punto di svolta nelle nostre case, introducendo una comodità senza precedenti nella gestione dei dispositivi smart. Tuttavia, la semplicità del comando parlato porta con sé una sfida persistente: la mancanza di contesto. Nel 2026, l’industria tech è costantemente alla ricerca di modalità per rendere questa interazione più intuitiva e meno ambigua. Tra le direzioni più promettenti, le ricerche di Apple suggeriscono un futuro in cui i dispositivi HomePod o soluzioni analoghe potrebbero interpretare il nostro sguardo per affinare la comprensione dei comandi vocali, trasformando radicalmente il modo in cui interagiamo con la domotica.

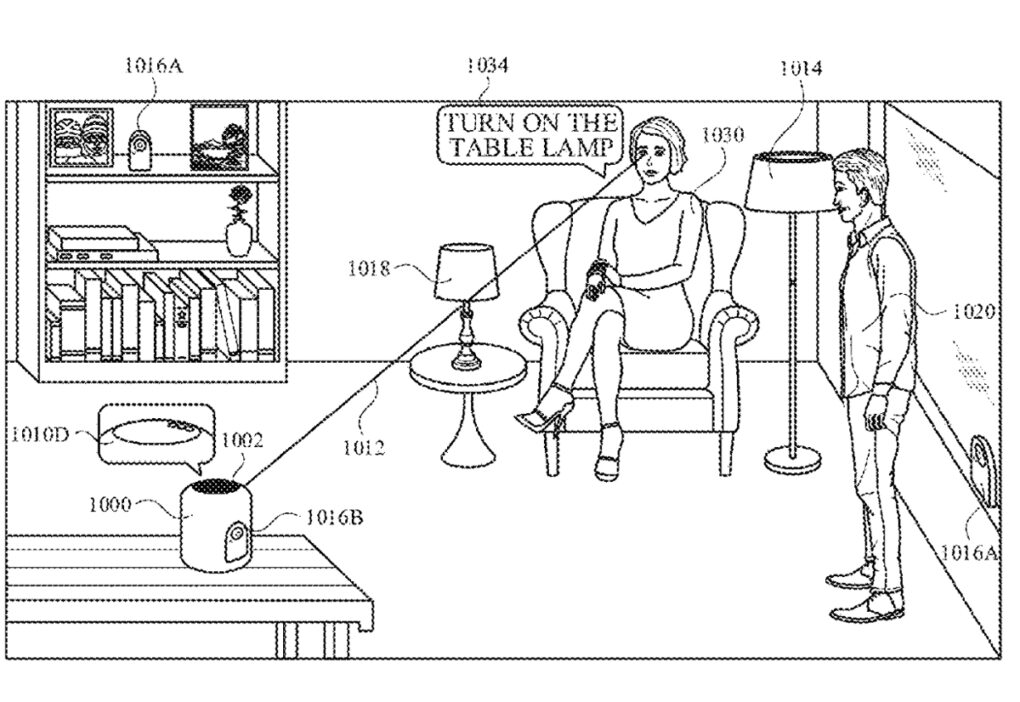

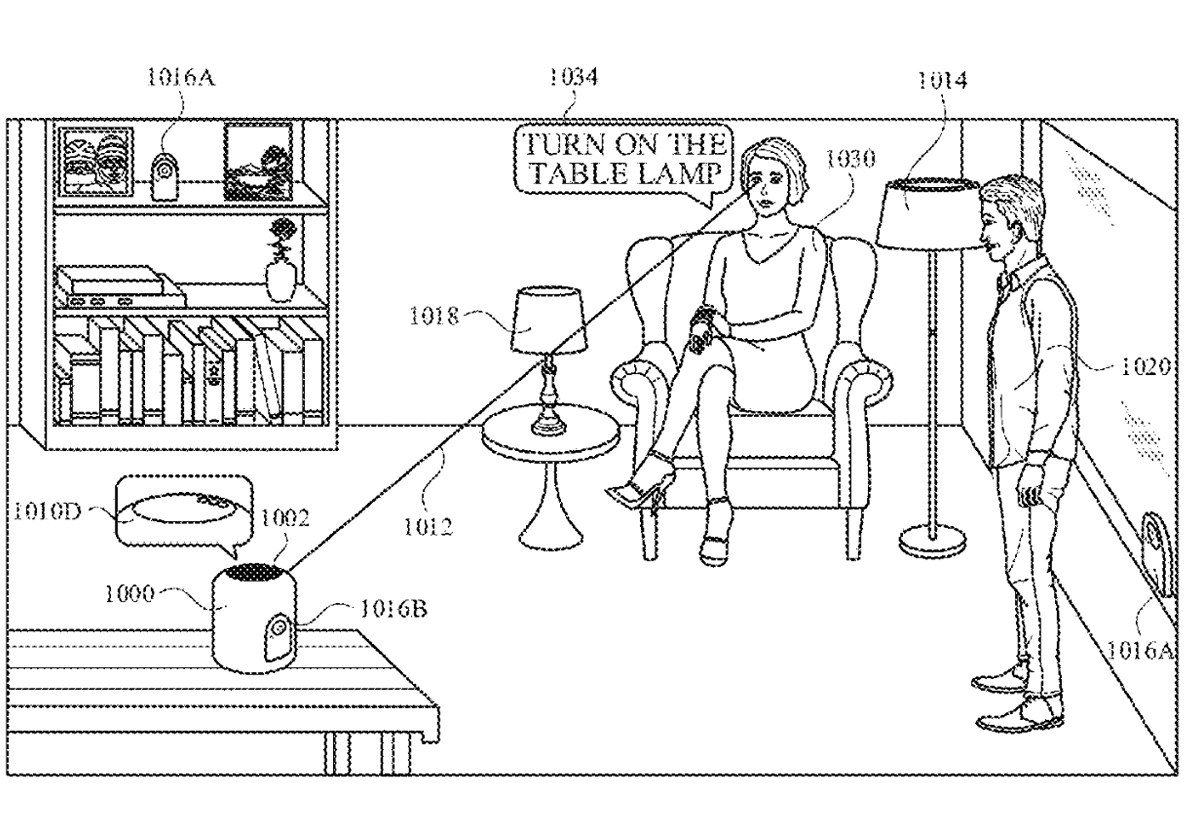

Immaginate di trovarvi in salotto, circondati da diverse fonti luminose, un televisore, un sistema audio. Attualmente, un comando come «accendi la luce» potrebbe risultare generico, richiedendo magari specificazioni aggiuntive come «accendi la lampada da terra» o «accendi la luce dietro al divano». Questo non solo interrompe il flusso naturale dell’interazione, ma può anche generare frustrazione. La visione che emerge dalle recenti esplorazioni tecnologiche di Apple mira a superare questa limitazione, consentendo al sistema di domotica di identificare con precisione l’oggetto a cui l’utente sta prestando attenzione, semplicemente osservando il suo sguardo. Questa capacità di discernimento potrebbe eliminare l’ambiguità, rendendo i comandi vocali non solo più semplici, ma anche incredibilmente più efficaci e naturali.

Oltre il Comando Vocale: La Ricerca di Contesto

La sfida principale degli assistenti vocali odierni risiede nella loro incapacità di interpretare l’intenzione dell’utente al di là delle parole pronunciate. Sebbene i progressi nell’elaborazione del linguaggio naturale (NLP) siano stati notevoli, la comprensione contestuale rimane un ostacolo significativo. Un sistema che integra la direzione dello sguardo dell’utente aggiungerebbe uno strato fondamentale di informazioni non verbali. Questo approccio multimodale, che combina input vocali con dati visivi, promette di colmare il divario tra ciò che diciamo e ciò che intendiamo realmente fare. Nel 2026, l’integrazione di sensori avanzati nei dispositivi smart home, come i futuri HomePod, potrebbe raccogliere queste informazioni in tempo reale, elaborandole per fornire risposte altamente contestualizzate.

Questa evoluzione non si limiterebbe all’illuminazione. Potrebbe estendersi al controllo di un televisore, di un impianto stereo, di un termostato o di qualsiasi altro dispositivo collegato all’ecosistema HomeKit. Un semplice «alza il volume» indirizzato al sistema audio che stiamo guardando, senza la necessità di specificare «alza il volume dell’HomePod in cucina» o «della soundbar», rappresenta un salto qualitativo nell’esperienza utente. Il sistema, attraverso la rilevazione dello sguardo, saprebbe esattamente quale dispositivo è il bersaglio del comando. Questo tipo di interazione intuitiva è ciò che molti utenti desiderano da tempo, una domotica che non solo risponde, ma che anticipa le nostre esigenze con una comprensione quasi umana.

L’Occhio Come Interfaccia: Precisione e Intuitività

L’utilizzo dello sguardo come parte dell’interfaccia utente non è una novità assoluta nel panorama tecnologico, ma la sua applicazione su larga scala nella domotica rappresenta un’area di ricerca attiva. La precisione richiesta per un sistema affidabile è elevatissima: deve essere in grado di distinguere tra un’occhiata fugace e un’attenzione prolungata, di operare in diverse condizioni di illuminazione e di adattarsi a vari utenti all’interno di un ambiente domestico. I sistemi di eye-tracking, sebbene complessi, hanno visto progressi significativi negli ultimi anni, divenendo più compatti e meno intrusivi. L’obiettivo è integrare questa tecnologia in modo che sia quasi invisibile all’utente, operando in background per migliorare l’esperienza senza richiedere uno sforzo consapevole.

L’intuitività è il secondo pilastro di questa innovazione. Un sistema che richiede calibrazioni complesse o gesti innaturali non raggiungerebbe il suo scopo. La promessa è quella di un’interazione che si senta completamente naturale, quasi come se i dispositivi fossero in grado di leggere la nostra mente. La capacità di combinare il comando vocale con l’indicazione visiva dello sguardo permetterebbe una comunicazione più diretta e meno mediata dalla tecnologia stessa. Questo si traduce in meno errori, meno ripetizioni e, in definitiva, un maggiore senso di controllo e armonia con l’ambiente domestico connesso. L’ecosistema Apple, con la sua attenzione all’integrazione hardware-software, si trova in una posizione privilegiata per esplorare queste frontiere, offrendo soluzioni che siano allo stesso tempo potenti e accessibili.

Le Sfide Tecnologiche e l’Integrazione

Implementare un sistema di eye-tracking affidabile in un dispositivo come un HomePod non è privo di ostacoli. La prima sfida riguarda l’hardware: sensori sufficientemente piccoli, efficienti dal punto di vista energetico e precisi, capaci di operare in una varietà di angolazioni e distanze tipiche di un ambiente domestico. La privacy è un’altra considerazione cruciale. Un sistema che monitora lo sguardo solleva interrogativi importanti su come i dati vengono raccolti, elaborati e protetti. La trasparenza e il controllo dell’utente su questi aspetti saranno fondamentali per l’accettazione su larga scala di tale tecnologia.

Inoltre, l’integrazione software richiede algoritmi sofisticati di intelligenza artificiale capaci di analizzare i dati dello sguardo in tempo reale, associandoli correttamente ai comandi vocali e ai dispositivi presenti nell’ambiente. Ciò implica una mappatura precisa della casa e dei suoi oggetti, un processo che deve essere semplice da configurare e mantenere. La robustezza del sistema in presenza di più persone nella stanza o di movimenti rapidi è un altro aspetto da perfezionare. Apple ha una storia di integrazione verticale che potrebbe facilitare lo sviluppo di soluzioni coerenti e performanti, ma la complessità intrinseca di questa tecnologia richiederà anni di ricerca e sviluppo. La interoperabilità con lo standard Matter, anch’esso in evoluzione, potrebbe giocare un ruolo nel rendere questi sistemi più ampiamente adottabili, anche se l’innovazione di Apple spesso parte da ecosistemi proprietari per poi influenzare standard più ampi.

Il Futuro dell’Interazione Domestica nel 2026

Nel 2026, l’evoluzione della domotica si muove verso sistemi sempre più proattivi e meno dipendenti da input espliciti. L’integrazione dello sguardo rappresenta un passo significativo in questa direzione, promettendo un’esperienza utente che si avvicina all’interazione naturale tra esseri umani. Non si tratta solo di accendere una luce, ma di creare un ambiente domestico che comprenda meglio le nostre intenzioni e si adatti di conseguenza. Questo tipo di innovazione potrebbe ridefinire le aspettative degli utenti riguardo ai dispositivi smart, spingendo l’intero settore verso soluzioni più sofisticate e personalizzate. I dispositivi HomePod, in questo scenario, potrebbero evolvere da semplici altoparlanti intelligenti a veri e propri hub centrali per un’interazione domestica multimodale, diventando il fulcro di un ecosistema che risponde non solo a ciò che diciamo, ma anche a dove guardiamo.

L’integrazione dello sguardo nei sistemi di domotica, come ipotizzato per i futuri HomePod, rappresenta un passo verso un’interazione più fluida e meno ambigua. Tuttavia, la strada per la sua implementazione su larga scala è costellata di complessità tecniche e considerazioni etiche. La direzione è chiara: rendere la tecnologia un’estensione più naturale del nostro intento, ma il percorso richiede un’attenta calibrazione tra innovazione e usabilità quotidiana.

Articolo originale su: Macitynet.it