Google elimina i consigli sanitari AI tratti da Reddit

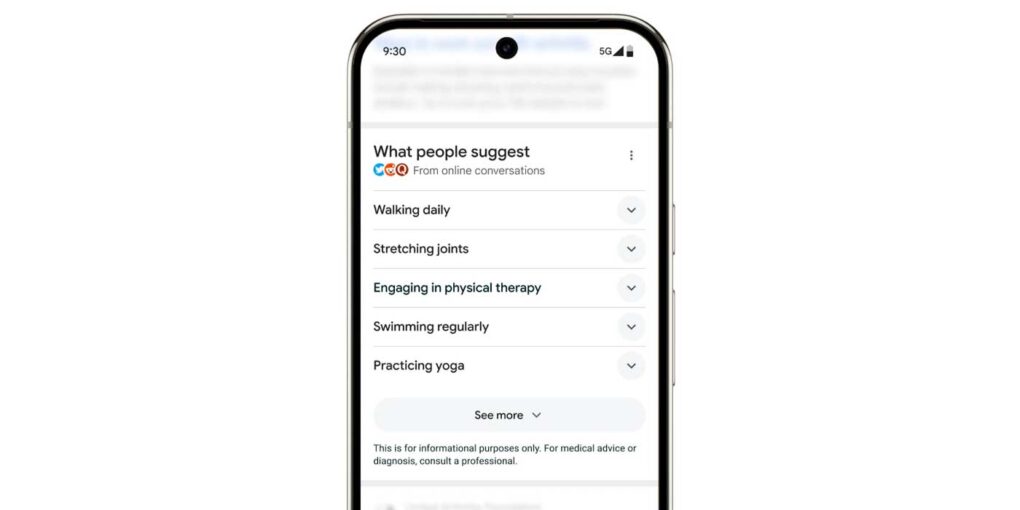

Google ha fatto marcia indietro su una delle sue funzionalità più controverse degli ultimi mesi. Il colosso di Mountain View ha definitivamente rimosso la sezione “What people suggest” (“Cosa suggerisce la gente”) dalle sue pagine dei risultati di ricerca, una feature che utilizzava l’intelligenza artificiale per riassumere consigli sanitari prelevati direttamente da Reddit e altre community online.

La decisione arriva dopo settimane di critiche e preoccupazioni da parte di esperti del settore medico e della comunità tech, che avevano sollevato seri dubbi sulla sicurezza di fornire suggerimenti sanitari non verificati direttamente nei risultati di ricerca principali. Una mossa che dimostra come anche Google stia ancora navigando a vista nel complesso mondo dell’AI applicata all’informazione sanitaria.

Il problema non era tanto la tecnologia in sé, quanto piuttosto la fonte dei contenuti: Reddit e forum simili, pur essendo ricchissimi di esperienze personali e discussioni approfondite, non possono essere considerati fonti mediche affidabili. Eppure l’algoritmo di Google li trattava alla stregua di contenuti autorevoli, creando un pericoloso cortocircuito informativo.

I rischi dell’AI sanitaria non supervisionata

La funzionalità “What people suggest” rappresentava uno degli esperimenti più audaci di Google nell’integrazione dell’intelligenza artificiale nei risultati di ricerca. Il sistema analizzava migliaia di discussioni su piattaforme come Reddit, estraeva i consigli più ricorrenti e li presentava in forma sintetizzata direttamente nella SERP. L’idea di base era interessante: sfruttare la saggezza collettiva degli utenti per fornire suggerimenti pratici e basati sull’esperienza reale.

Tuttavia, quando si tratta di salute, l’esperienza personale può essere fuorviante o addirittura pericolosa. Un consiglio che funziona per una persona potrebbe essere controindicato per un’altra, e senza il filtro di professionisti qualificati, questi suggerimenti diventavano potenziali bombe a orologeria. Gli esperti avevano evidenziato casi in cui l’AI aveva riassunto consigli discutibili o addirittura dannosi, presentandoli con l’autorevolezza tipica dei risultati di ricerca di Google.

Il caso si inserisce nel più ampio dibattito sulla responsabilità delle piattaforme tech quando si tratta di informazione sanitaria. Dopo la pandemia di COVID-19, che ha portato alla ribalta il fenomeno delle fake news mediche, aziende come Google si sono trovate a dover bilanciare innovazione e sicurezza degli utenti in un campo dove gli errori possono avere conseguenze gravi.

L’impatto sui risultati di ricerca e l’esperienza utente

La rimozione della funzionalità “What people suggest” non significa che Google abbia abbandonato l’integrazione dell’AI nei risultati di ricerca sanitari. L’azienda continua a lavorare su AI Overviews e altre feature simili, ma con un approccio più cauto e fonti più controllate. La lezione appresa è chiara: quando si tratta di salute, la velocità di implementazione deve cedere il passo alla verifica e alla sicurezza.

Per gli utenti italiani, questo cambiamento si traduce in una ricerca più “tradizionale” quando si cercano informazioni sanitarie su Google. Invece dei riassunti AI basati su Reddit, torneranno in primo piano i risultati provenienti da fonti mediche accreditate, siti istituzionali e portali sanitari verificati. Un passo indietro dal punto di vista dell’innovazione, ma un passo avanti per la sicurezza.

Interessante notare come questa decisione arrivi proprio mentre l’Unione Europea sta stringendo le maglie della regolamentazione sull’AI con l’AI Act, che pone particolare attenzione ai sistemi di intelligenza artificiale utilizzati in settori ad alto rischio come la sanità. Google potrebbe aver anticipato possibili problemi normativi, oltre a quelli reputazionali.

Il futuro dell’AI nella ricerca sanitaria

La vicenda della funzionalità “What people suggest” rappresenta un perfetto case study di come l’innovazione nell’AI debba essere bilanciata con la responsabilità sociale. OpenAI, Microsoft e altri player del settore stanno osservando con attenzione le mosse di Google, consapevoli che errori simili potrebbero compromettere la fiducia del pubblico nell’intera categoria.

Il futuro probabilmente vedrà un approccio ibrido: AI potente ma con controlli umani più stringenti, soprattutto in settori sensibili come la salute. Google sta già lavorando con organizzazioni mediche per sviluppare sistemi di verifica automatica dei contenuti sanitari, un processo più lento ma decisamente più sicuro.

Per i content creator e i siti web italiani specializzati in salute e benessere, questa decisione potrebbe rappresentare un’opportunità. Con meno concorrenza da parte dei contenuti AI-generated, i siti che producono informazione sanitaria di qualità, verificata e scritta da professionisti potrebbero vedere un ritorno in termini di visibilità organica sui motori di ricerca.

La strada verso un’AI sanitaria affidabile è ancora lunga, ma episodi come questo dimostrano che anche i giganti della tech sono disposti a fare marcia indietro quando la sicurezza degli utenti è in gioco. Una lezione di umiltà tecnologica che, in un settore spesso accusato di muoversi troppo velocemente, rappresenta un segnale positivo per il futuro dell’innovazione responsabile.

Fonte: 9to5Google