Grammarly sospende l’AI che impersonava scrittori famosi

Il mondo dell’intelligenza artificiale si trova nuovamente al centro di una controversia che tocca temi delicatissimi come il consenso, la proprietà intellettuale e l’etica tecnologica. Grammarly, uno degli assistenti di scrittura più utilizzati al mondo, ha dovuto fare marcia indietro su una delle sue funzionalità più controverse: Expert Review, un tool che utilizzava l’AI per generare feedback sui testi degli utenti spacciandoli come provenienti da scrittori, accademici e intellettuali famosi.

La vicenda rappresenta un perfetto esempio di come l’innovazione tecnologica possa scontrarsi con questioni etiche fondamentali, specialmente quando si tratta di utilizzare l’identità e la reputazione di persone reali senza il loro consenso. Una lezione che arriva in un momento in cui l’AI generativa sta rivoluzionando il modo in cui lavoriamo con i testi, ma solleva interrogativi sempre più pressanti sui limiti da non superare.

La controversa funzione Expert Review: quando l’AI si traveste

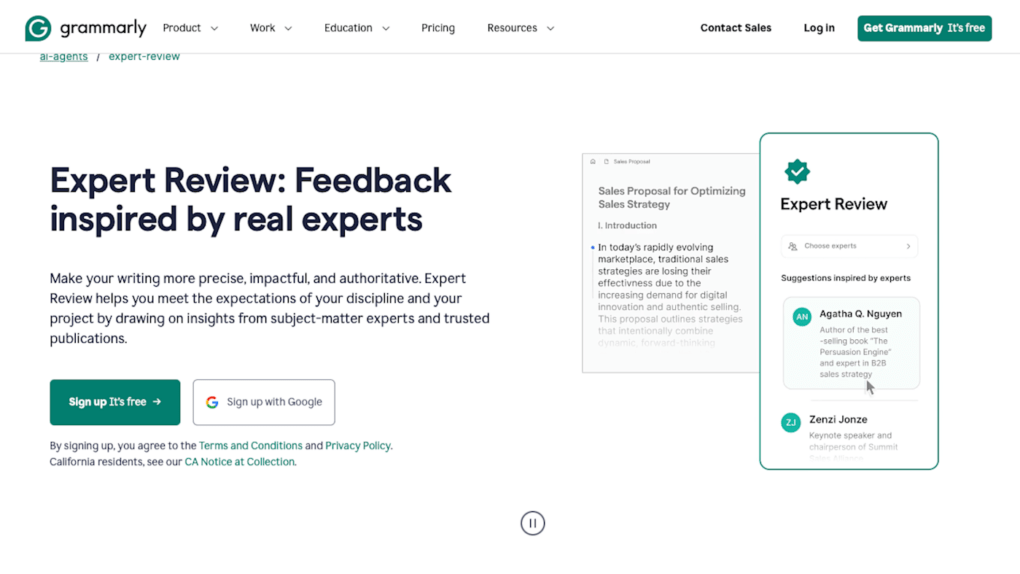

Lanciata lo scorso agosto, Expert Review prometteva di rivoluzionare il feedback sulla scrittura offrendo consigli personalizzati che sembravano provenire da menti brillanti del passato e del presente. Il meccanismo era tanto ingegnoso quanto problematico: l’AI analizzava il contenuto dell’utente e suggeriva feedback attribuendolo a esperti pertinenti all’argomento trattato. Poteva essere Carl Sagan per un testo scientifico, un autore bestseller per un romanzo, o persino blogger tecnologici per articoli del settore.

Il problema fondamentale risiedeva nel metodo utilizzato per “ricreare” questi esperti. Grammarly ammetteva che le ricreazioni si basavano su “informazioni pubblicamente disponibili provenienti da LLM di terze parti”, una formulazione che lasciava intendere l’utilizzo di web crawler e tecniche di scraping di dubbia legalità. In sostanza, l’azienda aveva creato dei “cloni digitali” di scrittori e intellettuali, vivi e morti, senza chiedere alcun permesso.

La clausola di esclusione di responsabilità inserita da Grammarly suonava più come un tentativo goffo di auto-protezione legale che come una vera giustificazione: “I riferimenti agli esperti in questo prodotto sono solo a scopo informativo e non indicano alcuna affiliazione con Grammarly o approvazione da parte di tali individui o entità”. Una pezza che difficilmente poteva coprire il buco etico di fondo.

La rivolta degli scrittori e le conseguenze legali

Come era prevedibile, non appena la funzionalità ha iniziato a farsi notare, è scoppiata la protesta. Gli scrittori viventi che si sono ritrovati “impersonati” dall’AI di Grammarly non l’hanno presa per niente bene, e chi può biasimarli? Vedere il proprio nome e la propria reputazione utilizzati per generare contenuti senza consenso rappresenta una violazione che va ben oltre il semplice aspetto tecnico.

La situazione è rapidamente degenerata quando è stata avviata una class action contro l’azienda. Il tentativo iniziale di Grammarly di risolvere la questione permettendo agli scrittori di “opt-out” dal sistema è apparso come un palliativo inadeguato. Come sottolineato sarcasticamente da molti osservatori, questa soluzione non poteva certo aiutare gli scrittori deceduti, né quelli ancora vivi ma ignari di essere stati “arruolati” dal sistema AI.

La class action rappresenta un precedente importante nell’ambito dell’AI generativa e dei diritti degli autori. Se dovesse andare a buon fine, potrebbe stabilire principi legali fondamentali su come le aziende tech possono (e non possono) utilizzare l’identità e il lavoro intellettuale di persone reali per alimentare i loro sistemi di intelligenza artificiale.

Il dietrofront di Grammarly e le prospettive future

Di fronte alla crescente pressione legale e mediatica, il CEO di Grammarly, Shishir Mehrotra, ha annunciato tramite un post su LinkedIn la sospensione temporanea di Expert Review. L’azienda ha dichiarato di voler “rivalutare” la funzionalità, una formulazione diplomatica che lascia aperte diverse possibilità per il futuro.

Nella sua dichiarazione, Mehrotra ha tentato di giustificare l’iniziativa sostenendo che “l’agente era progettato per aiutare gli utenti a scoprire prospettive influenti e scholarship rilevanti per il loro lavoro, fornendo anche modi significativi per gli esperti di costruire relazioni più profonde con i loro fan”. Una spiegazione che suona piuttosto surreale, soprattutto considerando che molti degli “esperti” coinvolti non erano nemmeno a conoscenza del loro coinvolgimento.

Questa vicenda solleva questioni fondamentali sul futuro dell’AI nel settore della scrittura assistita. Da un lato, abbiamo strumenti sempre più sofisticati che possono realmente migliorare la qualità dei nostri testi. Dall’altro, la corsa all’innovazione rischia di travolgere principi etici e legali consolidati, creando un Far West digitale dove tutto sembra lecito in nome del progresso tecnologico.

Il caso Grammarly potrebbe diventare un punto di svolta per l’industria dell’AI, stabilendo confini più chiari tra innovazione legittima e appropriazione indebita. Per gli utenti italiani e europei, questa vicenda assume particolare rilevanza considerando il quadro normativo GDPR, che offre protezioni più robuste contro l’uso non consensuale dei dati personali. La lezione è chiara: l’intelligenza artificiale deve evolversi rispettando i diritti umani, non sostituendosi ad essi senza permesso.