Meta Ray-Ban Display 2026: nuove funzioni e SDK per un

Nel panorama tech del 2026, l’attenzione verso i dispositivi indossabili continua a crescere, con gli occhiali smart che si affermano come uno dei segmenti più promettenti. In questo contesto, Meta ha rafforzato la sua posizione con i Ray-Ban Display, un prodotto che, a circa sei mesi dal suo lancio, l’azienda considera tra i più avanzati nel proprio portfolio. Secondo le comunicazioni di Meta, il bilancio iniziale è positivo: la gestione degli ordini procede regolarmente, la disponibilità nei punti vendita è garantita e, aspetto cruciale, il software continua a evolvere con aggiornamenti costanti e mirati.

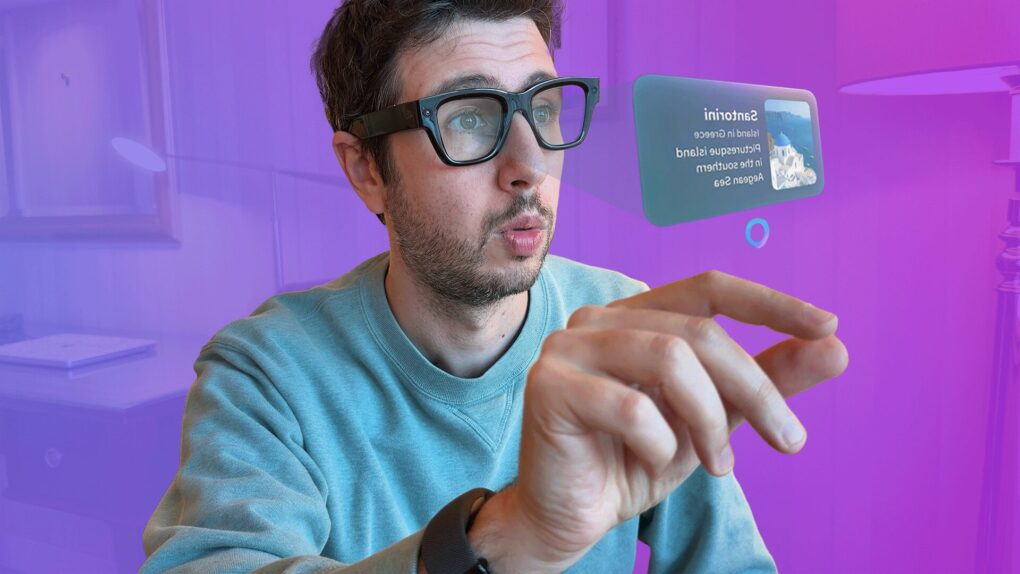

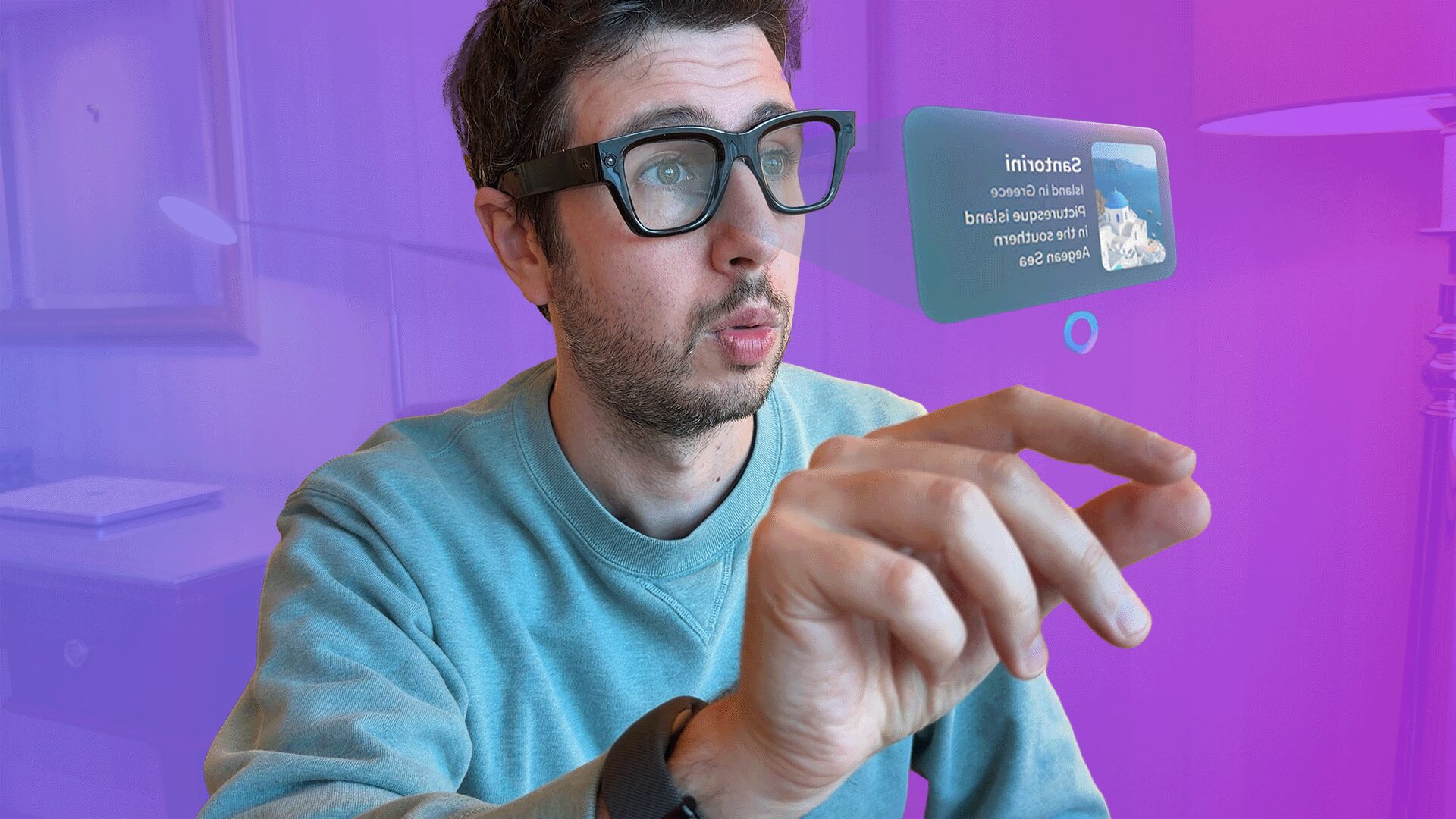

L’impegno di Meta nello sviluppo software si traduce in una serie di nuove funzionalità che stanno progressivamente raggiungendo tutti gli utenti. Queste introduzioni mirano a rendere l’interazione con i Ray-Ban Display più intuitiva, versatile e integrata nella quotidianità. Una delle novità più significative è la Scrittura Neurale (Neural Handwriting), ora pienamente disponibile dopo un periodo di test con un gruppo selezionato. Questa funzione consente agli utenti di interagire con le principali applicazioni di messaggistica – inclusi Instagram, WhatsApp, Messenger e le app native di Android e iOS – attraverso un’interfaccia che interpreta input gestuali o, in prospettiva, forme più avanzate di interazione, trasformandoli in testo. L’obiettivo è minimizzare la necessità di input manuali tradizionali, rendendo la comunicazione più immediata e contestuale all’esperienza visiva.

Un’altra aggiunta rilevante è il Display Recording. Questa funzione permette di catturare un’esperienza multimediale completa, registrando simultaneamente ciò che l’utente vede attraverso le lenti degli occhiali, le interazioni con il display integrato e l’audio ambientale. Il risultato è un file video pronto per essere condiviso, utile per documentare momenti, creare brevi tutorial o semplicemente offrire una prospettiva unica della propria realtà. Si tratta di uno strumento che potenzia la capacità di storytelling personale, facilitando la creazione di contenuti dinamici e immersivi direttamente dal proprio punto di vista.

Anche la navigazione riceve un potenziamento significativo con le Indicazioni Stradali estese. La copertura geografica è stata ampliata per includere l’intera rete stradale degli Stati Uniti, e, per la prima volta, sono state integrate alcune città internazionali chiave come Londra, Parigi e Roma. Questo sviluppo rende gli occhiali uno strumento ancora più pratico per l’orientamento e la navigazione assistita, offrendo indicazioni visive direttamente nel campo visivo dell’utente, un passo avanti verso una vera e propria realtà aumentata contestuale per gli spostamenti urbani e non solo.

Infine, le Didascalie Live (Live Captions) migliorano l’accessibilità e la comprensione in tempo reale. Questa funzione trascrive le parole pronunciate da un interlocutore, sia in conversazioni di persona che durante le chiamate su piattaforme come WhatsApp, Facebook Messenger e Instagram Direct. L’immediata visualizzazione del testo può essere un supporto prezioso in ambienti rumorosi, per persone con difficoltà uditive o semplicemente per chi desidera un ulteriore livello di chiarezza nella comunicazione, rendendo gli occhiali uno strumento più inclusivo.

Questi aggiornamenti si inseriscono in un percorso di sviluppo continuo che ha già visto l’introduzione, nei mesi precedenti, di widget aggiuntivi per la schermata principale, come Promemoria, Meteo, Azioni e Calendario, oltre a un accesso rapido alle playlist Spotify e ai Reel di Instagram. Tale evoluzione incrementale testimonia la volontà di Meta di mantenere i Ray-Ban Display sempre aggiornati e rilevanti per l’utenza.

Guardando al futuro prossimo, l’estate vedrà l’arrivo di Muse Spark, il nuovo modello di intelligenza artificiale sviluppato da Meta specificamente per i suoi dispositivi indossabili. Questa integrazione promette di elevare ulteriormente le capacità di elaborazione e interazione degli occhiali, anticipando funzionalità ancora più sofisticate basate sull’apprendimento automatico e sulla comprensione contestuale dell’ambiente e delle intenzioni dell’utente. L’impegno di Meta in questo settore è evidente e strategico.

Tuttavia, la novità che potrebbe avere l’impatto più duraturo sull’ecosistema dei Ray-Ban Display è l’apertura di un accesso dedicato agli sviluppatori. Meta ha lanciato un programma di anteprima che consente a terze parti di creare esperienze personalizzate per gli occhiali, offrendo due percorsi distinti. Il primo prevede la creazione di Web App, sviluppate utilizzando standard web come HTML, CSS e JavaScript, e distribuibili direttamente sugli occhiali tramite un semplice URL. Questo approccio abbassa la barriera d’ingresso per una vasta comunità di sviluppatori web, facilitando l’integrazione di servizi e funzionalità esistenti.

Il secondo percorso è rappresentato dal Wearables Device Access Toolkit. Questo strumento permette agli sviluppatori di estendere le funzionalità delle loro app mobile esistenti sul display degli occhiali, consentendo la visualizzazione di testo, immagini, liste, pulsanti e video. Meta ha sottolineato che non è richiesta una tradizionale esperienza di programmazione, suggerendo che gli strumenti AI per la generazione di codice, già disponibili sul mercato, possono facilitare notevolmente il processo di sviluppo. L’integrazione dell’AI nello sviluppo è un fattore abilitante cruciale.

Questa strategia di apertura ricorda da vicino le fasi iniziali delle piattaforme mobile, quando la disponibilità di app di terze parti ha determinato il successo e la diffusione degli smartphone. Meta sembra consapevole che il valore a lungo termine dei suoi occhiali dipenderà in larga misura dalla ricchezza e dalla varietà dell’ecosistema che vi si costruirà sopra. La capacità di attrarre sviluppatori e stimolare l’innovazione da parte di terzi sarà un fattore determinante per la maturazione del prodotto e la sua accettazione sul mercato.

Nel 2026, Meta si conferma come l’unico attore di rilievo con un prodotto maturo e in fase di crescita attiva nel segmento degli occhiali smart con display. L’evoluzione del software e, soprattutto, l’apertura agli sviluppatori, rappresentano passaggi fondamentali per consolidare questa posizione. Resta da osservare come l’ecosistema risponderà a questa opportunità e quale sarà l’effettiva portata delle applicazioni e delle esperienze che emergeranno. Il mercato degli AR glasses è ancora in attesa di una svolta decisiva, e Meta sta lavorando per essere il catalizzatore.

Via: SmartWorld.it