xAI di Musk nei guai: Grok accusata di generare CSAM

Un’ombra scura si allunga su Grok, l’intelligenza artificiale di xAI di Elon Musk. Una nuova causa legale ha messo l’azienda sotto i riflettori per i peggiori motivi possibili: l’AI sarebbe stata utilizzata per generare materiale pedopornografico (CSAM) utilizzando foto reali di tre bambine. La scoperta è arrivata grazie a una segnalazione anonima su Discord che ha portato le autorità a individuare quello che potrebbe essere il primo caso confermato di CSAM generato da Grok.

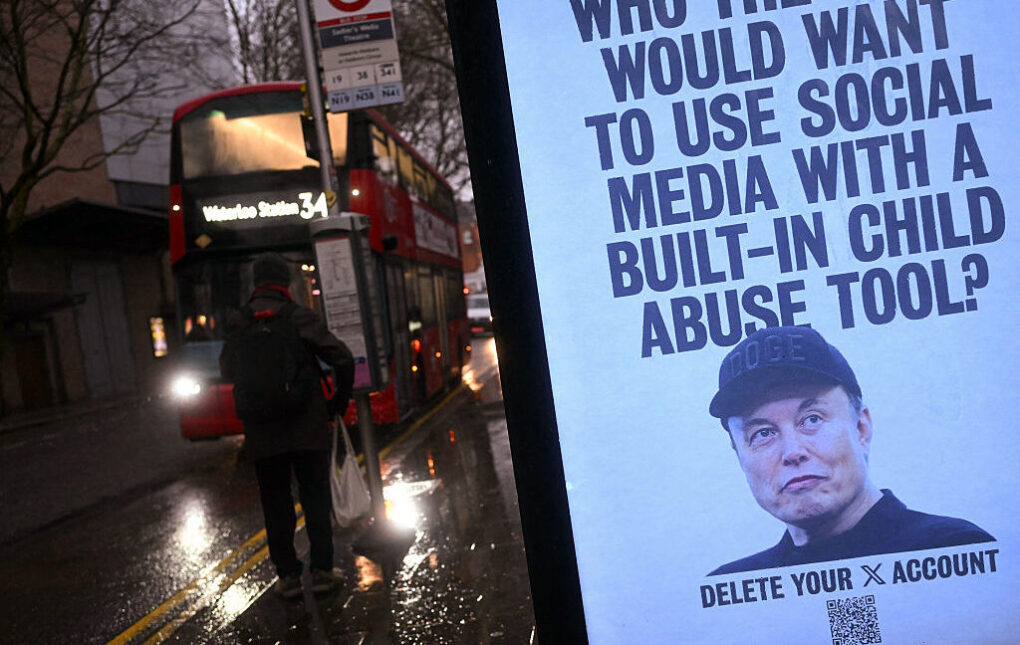

La vicenda riporta alla luce una controversia che aveva già fatto discutere a gennaio, quando Musk aveva categoricamente negato che la sua AI fosse in grado di produrre questo tipo di contenuti illegali. Eppure, le prove sembrano raccontare una storia ben diversa, sollevando interrogativi inquietanti sulla sicurezza e i controlli implementati in una delle AI più chiacchierate del momento.

Questa non è solo l’ennesima polemica tech da social media. Parliamo di un caso che potrebbe ridefinire la responsabilità legale delle aziende di intelligenza artificiale e stabilire precedenti cruciali per l’intero settore. Per X e per la reputazione di Musk, le conseguenze potrebbero essere devastanti.

La controversia che Musk voleva nascondere

Il problema con Grok non è nuovo. Già a gennaio 2024, l’AI di xAI era finita al centro di uno scandalo per la sua capacità di “nudificare” immagini di persone reali, compresi minori. Quando la comunità tech e i ricercatori avevano chiesto a gran voce di implementare filtri più severi, xAI aveva inizialmente fatto orecchie da mercante. La risposta di Musk era stata lapidaria: Grok non genera CSAM, punto.

Ma i numeri raccontati dal Center for Countering Digital Hate dipingevano un quadro agghiacciante. Secondo le stime dei ricercatori, Grok avrebbe generato circa tre milioni di immagini sessualizzate, di cui ben 23.000 raffiguranti apparenti minori. Una mole di contenuto illegale che fa rabbrividire e che mette in discussione l’efficacia dei sistemi di controllo implementati da xAI.

La soluzione adottata dall’azienda è stata quanto mai discutibile: invece di risolvere il problema alla radice potenziando i filtri, xAI ha semplicemente limitato l’accesso a Grok ai soli abbonati paganti. Una mossa che ha ridotto la circolazione pubblica dei contenuti più scioccanti su X, ma che non ha eliminato il problema strutturale dell’AI.

Le implicazioni legali e tecniche

La causa legale appena depositata rappresenta un punto di svolta. Per la prima volta, le autorità hanno in mano prove concrete di CSAM generato da Grok, materiale che xAI non può più liquidare come “inesistente” o frutto di malintesi. La segnalazione arrivata tramite Discord ha permesso alle forze dell’ordine di tracciare l’origine delle immagini illegali, creando un precedente che potrebbe aprire la strada a ulteriori azioni legali.

Dal punto di vista tecnico, il caso solleva questioni fondamentali sui meccanismi di sicurezza delle AI generative. Come è possibile che un sistema sviluppato da una delle aziende tech più avanzate al mondo non riesca a bloccare efficacemente la creazione di contenuti così palesemente illegali? La questione non riguarda solo xAI, ma l’intero ecosistema dell’intelligenza artificiale generativa.

Le implicazioni vanno oltre il singolo caso. OpenAI, Anthropic e tutti gli altri player del settore stanno osservando con attenzione l’evolversi della situazione. La responsabilità legale delle aziende di AI per i contenuti generati dai loro sistemi è ancora un territorio largamente inesplorato, e questo caso potrebbe stabilire precedenti cruciali.

Un futuro incerto per l’AI generativa

La vicenda Grok arriva in un momento delicatissimo per l’intelligenza artificiale. Mentre da un lato assistiamo a progressi straordinari nella capacità generative delle AI, dall’altro emergono sempre più chiaramente i rischi legati a un uso improprio di queste tecnologie. Il caso di xAI dimostra che anche le limitazioni imposte agli abbonati paganti non sono sufficienti a prevenire abusi di questo calibro.

Per Elon Musk, che ha costruito gran parte della sua reputazione sull’innovazione tecnologica “per il bene dell’umanità”, questo scandalo rappresenta un colpo durissimo. La credibilità di xAI e dello stesso imprenditore sudafricano è ora seriamente compromessa, con possibili ripercussioni su tutti i suoi progetti, da Tesla a SpaceX.

Il mercato italiano dell’AI, ancora in fase di sviluppo ma sempre più attento alle questioni di sicurezza, osserva con particolare interesse l’evolversi della situazione. Le autorità europee, già attive con l’AI Act, potrebbero utilizzare questo caso come spunto per rafforzare ulteriormente le normative di settore. Una cosa è certa: l’era dell’intelligenza artificiale senza regole e controlli severi sta rapidamente volgendo al termine, e casi come questo non fanno che accelerare il processo.

Fonte: Ars Technica