DeepSeek V4 (2026): Promesse d’AI o Fumo negli Occhi?

Nel panorama dell’intelligenza artificiale generativa del 2026, dove ogni settimana porta un nuovo modello a promettere la luna, le recenti affermazioni di DeepSeek con i suoi V4 Pro e Flash meritano un’analisi ben più che superficiale. L’azienda, che poco più di un anno fa si trovava al centro di polemiche per questioni di sicurezza nazionale e privacy, torna alla ribalta sbandierando una capacità di ragionamento ‘di livello mondiale’ e una ‘lunghezza di contesto da 1 milione a costi contenuti’. Ma è davvero un passo avanti rivoluzionario o l’ennesima narrazione ottimistica di un vendor che cerca di scrollarsi di dosso un passato ingombrante?

La mia tesi è chiara: dietro le cifre impressionanti e le parole altisonanti, si nasconde una realtà fatta di sfide non risolte, ambiguità nella misurazione delle performance e un contesto geopolitico che rende ogni lancio di AI non solo una questione tecnologica, ma anche politica. L’open-source, sbandierato come vessillo di trasparenza, si confronta con le ombre dei divieti passati. È tempo di guardare oltre il marketing.

Promesse Audaci e la Reale Misura dell’Intelligenza

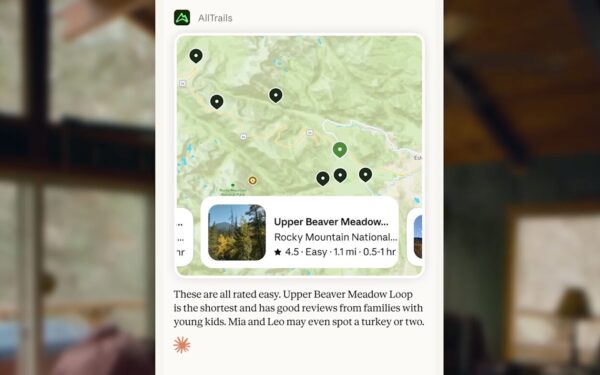

DeepSeek annuncia con enfasi l’arrivo dei suoi modelli V4 Pro e V4 Flash, presentandoli come campioni di efficienza e intelligenza. La frase di lancio, ‘Benvenuti nell’era della lunghezza di contesto da 1 milione a costi contenuti’, suona certamente attraente. La lunghezza di contesto, lo sappiamo, è il numero massimo di token che un modello AI può ‘ricordare’ in una conversazione; più è grande, più la coerenza e la consistenza in dialoghi estesi dovrebbero migliorare. In questo senso, DeepSeek si pone in linea con i giganti del settore, menzionando ad esempio che il recente GPT-5.5 di OpenAI offre una finestra di contesto che varia da 400.000 a 1 milione di token. Ma cosa significa ‘costi contenuti’ nel mondo reale, al di là del comunicato stampa?

Il V4 Pro, in particolare, viene descritto come dotato di ‘capacità agentiche migliorate’ e capace di ‘competere con i principali modelli closed-source’ in termini di ragionamento, superato solo da Gemini-3.1-Pro per ‘ricchezza di conoscenza del mondo’. Il V4 Flash, pur meno potente, promette tempi di risposta più rapidi e capacità di ragionamento ‘vicine’ al Pro, con prestazioni alla pari per ‘semplici task di Agente’. Queste sono dichiarazioni pesanti. Ma come si misura esattamente la ‘capacità di ragionamento’ o la ‘conoscenza del mondo’ in modo oggettivo e universalmente accettato? Spesso, questi benchmark interni o auto-dichiarati possono essere manipolati o interpretati in modi che favoriscono il vendor. Siamo di fronte a metriche standardizzate e indipendenti o a un’ottimizzazione del linguaggio per impressionare il mercato? La trasparenza, soprattutto per un modello che si definisce open-source, dovrebbe estendersi anche alle metodologie di valutazione.

Open-Source: Libertà o Cavallo di Troia?

Un aspetto centrale della strategia di DeepSeek è la natura open-source dei suoi modelli, permettendo agli utenti di scaricare e modificare il codice. L’open-source, in linea di principio, è una benedizione per l’innovazione, promuovendo la trasparenza, la collaborazione e una rapida evoluzione. Tuttavia, nel caso di DeepSeek, questa bandiera di libertà sventola su un terreno non privo di polemiche. Poco dopo aver raggiunto la vetta delle classifiche dell’App Store di Apple negli Stati Uniti, l’applicazione di DeepSeek è stata bandita dalle agenzie federali statunitensi e dai dispositivi governativi. Le autorità la ritenevano un ‘rischio per la sicurezza nazionale’ e una ‘minaccia per le azioni AI statunitensi’. Anche la Corea del Sud aveva sospeso i download della sua app per ‘problemi di privacy’.

Questi precedenti gettano un’ombra lunga sull’attuale lancio. Un modello open-source, per quanto trasparente nel codice, può comunque essere addestrato su dataset che sollevano interrogativi, o può essere sviluppato da entità con legami ambigui. La domanda cruciale è: l’open-source è sufficiente a dissipare preoccupazioni così gravi? O è, in questo contesto, un modo per accelerare l’adozione e la diffusione, mentre le questioni più profonde rimangono irrisolte? La comunità tech ha il dovere di interrogarsi non solo sulla bontà del codice, ma sull’intero ecosistema che lo produce e lo distribuisce. La fiducia non si costruisce solo con l’apertura tecnica, ma con una condotta etica e una trasparenza a 360 gradi.

Il Contesto Geopolitico e i Rischi Nascosti

Le decisioni degli Stati Uniti e della Corea del Sud non sono state prese alla leggera. La preoccupazione per la ‘sicurezza nazionale’ e per la ‘minaccia alle azioni AI’ non riguarda solo il potenziale spionaggio o la fuga di dati sensibili, ma anche il controllo sulla tecnologia di base. In un mondo sempre più polarizzato, chi detiene le redini dello sviluppo AI detiene un potere enorme. I modelli di AI, soprattutto quelli con capacità di ragionamento avanzate e lunghe finestre di contesto, possono essere utilizzati per scopi che vanno ben oltre la semplice generazione di testo o codice: dalla disinformazione su larga scala alla sorveglianza, fino allo sviluppo di sistemi autonomi critici.

In questo scenario, la provenienza di un modello AI e i suoi legami con determinate giurisdizioni diventano fattori determinanti. Le preoccupazioni sulla privacy sollevate dalla Corea del Sud, d’altronde, richiamano alla mente la necessità di aderire a normative stringenti come il GDPR, particolarmente rilevanti in Europa. Un’azienda che è stata oggetto di tali divieti in passato deve dimostrare un cambiamento radicale nelle sue politiche e nelle sue pratiche. Altrimenti, le sue affermazioni, per quanto tecnicamente impressionanti, rimarranno sotto il microscopio della diffidenza, rendendo difficile una piena adozione in contesti dove la sicurezza e la sovranità dei dati sono prioritarie.

DeepSeek V4 in Italia: Cosa Significa per Noi?

Per gli sviluppatori, le aziende e gli utenti italiani, l’arrivo di DeepSeek V4 nel 2026 solleva interrogativi non banali. Da un lato, l’accessibilità a un modello open-source che promette prestazioni di alto livello e una notevole lunghezza di contesto può rappresentare un’opportunità per innovare a costi potenzialmente inferiori, riducendo la dipendenza dai colossi tech americani. La possibilità di modificare il codice offre una flessibilità preziosa per adattare l’AI a specifici contesti e requisiti locali. Questo è il lato positivo della medaglia, la promessa di democratizzazione dell’AI.

Dall’altro lato, le preoccupazioni sollevate in passato da Stati Uniti e Corea del Sud non possono essere ignorate. Le aziende italiane, soprattutto quelle che operano in settori sensibili o che gestiscono dati personali, dovranno valutare attentamente i rischi legati all’adozione di un modello che ha già avuto problemi di sicurezza e privacy. La conformità al GDPR, la protezione dei dati dei cittadini e la resilienza infrastrutturale sono priorità assolute. Prima di abbracciare entusiasticamente le ‘promesse’ di DeepSeek, è fondamentale condurre una due diligence rigorosa, non solo sul codice, ma anche sulle pratiche di governance dell’azienda e sull’affidabilità a lungo termine. L’innovazione è cruciale, ma non a discapito della sicurezza e della sovranità digitale. Il prezzo italiano non è ancora stato annunciato, ma il vero costo potrebbe non essere monetario.

Via: Engadget