TPU 8: Google spinge sull’era agentica nel 2026

Nel 2026, il panorama dell’intelligenza artificiale è un campo di battaglia dove ogni gigante tech cerca il proprio vantaggio competitivo. Mentre la maggior parte delle aziende si affanna ad accaparrarsi ogni singolo acceleratore AI prodotto da Nvidia, c’è chi, come Google, ha scelto una strada differente. Una strada che non è solo alternativa, ma, a mio parere, strategica e lungimirante.

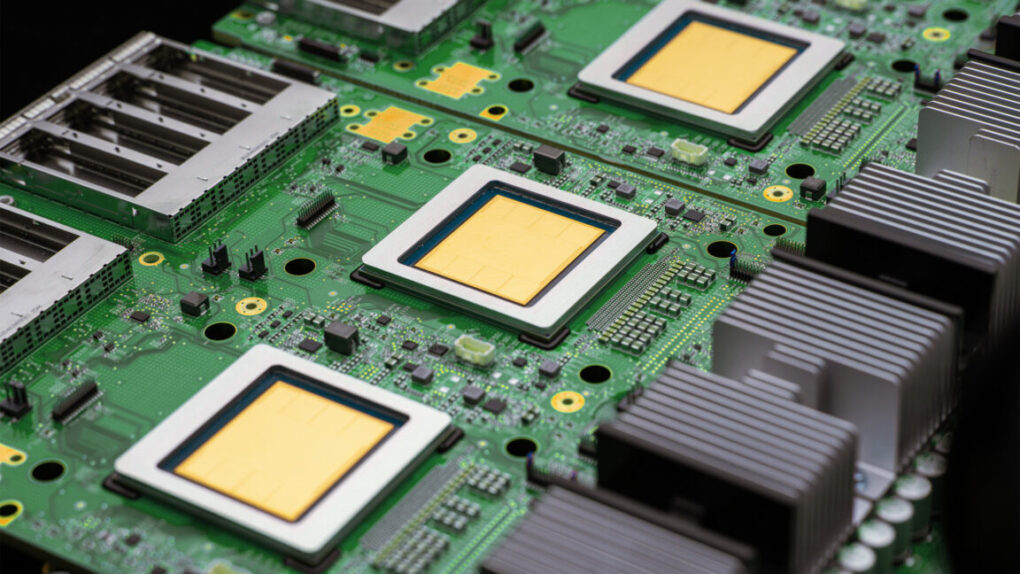

Parlo della linea di Tensor Processing Unit (TPU), i chip custom che da anni costituiscono l’ossatura dell’infrastruttura AI di Google Cloud. Dopo aver annunciato la settima generazione, Ironwood, nel 2025, il colosso di Mountain View ha già fatto un passo avanti significativo, presentando l’ottava generazione. E non stiamo parlando di un semplice upgrade di velocità; questa mossa è una dichiarazione d’intenti chiara e forte per quella che Google definisce l'”era agentica” dell’AI.

Per me, questa è la dimostrazione che Google non si limita a inseguire il mercato, ma cerca di plasmarlo. L’idea è semplice ma potente: se l’AI sta cambiando, anche l’hardware che la supporta deve evolversi in modo radicale. Non basta più una maggiore potenza bruta; serve un’architettura pensata per le nuove sfide.

Analisi dell’Innovazione: TPU 8t e TPU 8i per l’Era Agentica

Le nuove TPU arrivano in due varianti distinte, ognuna con un focus preciso: la TPU 8t per il training e la TPU 8i per l’inference. Questa differenziazione non è casuale, ma risponde a esigenze specifiche del ciclo di vita di un modello AI. Prima che un’intelligenza artificiale possa analizzare dati, generare contenuti o, come dice Google, diventare un “agente” capace di compiere azioni complesse, deve essere addestrata. E questo processo, per i modelli di frontiera attuali, è incredibilmente oneroso in termini di tempo e risorse.

La TPU 8t è stata progettata proprio per accelerare questa fase cruciale. Google dichiara che è in grado di ridurre i tempi di training per i modelli AI più avanzati da mesi a settimane. Questo è un dato che, pur non essendo un numero preciso, ha un impatto enorme. Immaginate cosa significa per i ricercatori e gli sviluppatori poter iterare sui modelli molto più velocemente. Significa accelerare la ricerca, permettere sperimentazioni più audaci e portare innovazioni sul mercato con una rapidità impensabile fino a poco tempo fa. Non è solo una questione di velocità, è una questione di agilità e capacità innovativa.

Dall’altra parte, la TPU 8i è ottimizzata per l’inference, ovvero la fase in cui il modello AI, una volta addestrato, viene utilizzato per svolgere il suo compito. L’efficienza nell’inference è fondamentale per ridurre i costi operativi e migliorare la reattività dei servizi basati sull’AI. Un modello potentissimo ma lento o troppo costoso da eseguire non è utile nella pratica quotidiana. L’obiettivo qui è rendere l’AI utilizzabile su larga scala, in applicazioni che vanno dalla diagnostica medica alla gestione autonoma di sistemi complessi.

Questa architettura duale, a mio parere, è la mossa vincente di Google. Riconoscere che training e inference hanno esigenze hardware diverse e ottimizzare i chip per ciascuna fase è un approccio pragmatico che massimizza l’efficienza complessiva. È un segno di maturità nel design dell’hardware AI, andando oltre il semplice “più core, più potenza”.

Il Contesto Strategico: Google contro il Dominio Nvidia

Google non è nuova alla strategia del silicio custom. Fin dall’introduzione delle prime TPU, ha dimostrato una chiara visione: per controllare il proprio destino nell’era dell’AI, è fondamentale controllare l’hardware sottostante. Questo approccio si contrappone nettamente a quello di molte altre aziende, che si affidano quasi esclusivamente alle GPU di Nvidia per le loro infrastrutture AI.

Non fraintendetemi, le GPU di Nvidia sono straordinarie e hanno abilitato gran parte della rivoluzione AI che stiamo vivendo. Ma la scelta di Google di investire massicciamente nelle proprie TPU le conferisce un vantaggio strategico non indifferente. Primo, le permette di ottimizzare l’hardware specificamente per i propri framework e servizi AI, come TensorFlow e JAX, ottenendo prestazioni ed efficienza che un hardware più generico difficilmente potrebbe eguagliare. Secondo, riduce la dipendenza da un singolo fornitore, un fattore cruciale in un mercato dove la domanda di acceleratori AI supera di gran lunga l’offerta.

L'”era agentica” menzionata da Google è un concetto chiave per capire la direzione che l’azienda vuole intraprendere. Non si tratta più solo di creare modelli che rispondono a prompt o classificano immagini, ma di sviluppare AI capaci di ragionamento complesso, pianificazione a lungo termine, apprendimento continuo e interazione autonoma con l’ambiente. Pensate ad agenti AI in grado di gestire interi flussi di lavoro, prendere decisioni in autonomia o risolvere problemi complessi senza intervento umano costante. Per abilitare questi sistemi, servono non solo algoritmi più sofisticati, ma anche un hardware che possa supportare l’enorme carico computazionale e la flessibilità richiesta.

La mossa di Google con le TPU 8t e 8i è quindi un tassello fondamentale in questa visione. È un investimento non solo nell’hardware, ma nel futuro stesso dell’intelligenza artificiale, cercando di definire i contorni di ciò che sarà possibile fare con l’AI nei prossimi anni. È un segnale che il mercato del silicio per l’AI è in continua evoluzione e che la personalizzazione sarà sempre più la chiave per l’innovazione.

Per approfondire le capacità delle TPU di Google, potete consultare la pagina ufficiale di Google Cloud sui Tensor Processing Units. Per una prospettiva più ampia sull'”era agentica”, un buon punto di partenza potrebbe essere questo articolo di MIT Technology Review sull’ascesa degli agenti AI.

Prospettiva Futura: L’Impatto delle TPU 8 nel 2026 e Oltre

La disponibilità delle TPU 8t e 8i per i clienti di Google Cloud non è solo un vantaggio per Google stessa, ma per l’intero ecosistema AI. Le aziende che si affidano a Google Cloud avranno accesso a una piattaforma AI più veloce ed efficiente, permettendo loro di sviluppare e implementare i propri modelli con maggiore rapidità e a costi potenzialmente inferiori. Questo democratizza l’accesso a capacità di calcolo di frontiera, rendendo l’innovazione AI più accessibile anche a realtà che non hanno le risorse per costruire la propria infrastruttura da zero.

Nel 2026, l’impatto di questa mossa si farà sentire in diversi settori. Dal biotech, dove la velocità di training può accelerare la scoperta di nuovi farmaci, alla finanza, con modelli predittivi più precisi e veloci, fino alla robotica e ai veicoli autonomi, dove l’inference efficiente è vitale per la sicurezza e la reattività. La riduzione dei tempi di training da mesi a settimane è un game changer. Significa che un’idea può passare dalla concezione alla prototipazione, e poi all’implementazione, in una frazione del tempo precedentemente richiesto.

La mia opinione è che Google stia posizionandosi non solo come fornitore di servizi AI, ma come abilitatore fondamentale della prossima generazione di intelligenza artificiale. L’investimento nelle TPU è un chiaro segnale che l’azienda crede fermamente nel proprio approccio e nella capacità di dettare il ritmo dell’innovazione hardware per l’AI.

La vera domanda è: quanto velocemente il mercato si adatterà a questa spinta verso l'”era agentica”? E quanto le altre Big Tech si sentiranno spinte a seguire l’esempio di Google, investendo ancora di più in silicio custom? Io credo che nei prossimi 6-12 mesi vedremo un aumento significativo nell’adozione delle soluzioni AI di Google Cloud da parte di aziende che necessitano di tempi di training ridotti e inference efficiente, consolidando la posizione di Google come leader nell’infrastruttura per l’AI di nuova generazione.

Articolo originale su: Ars Technica