Gemini ordina il cappuccino da solo: l’AI di Google è realtà

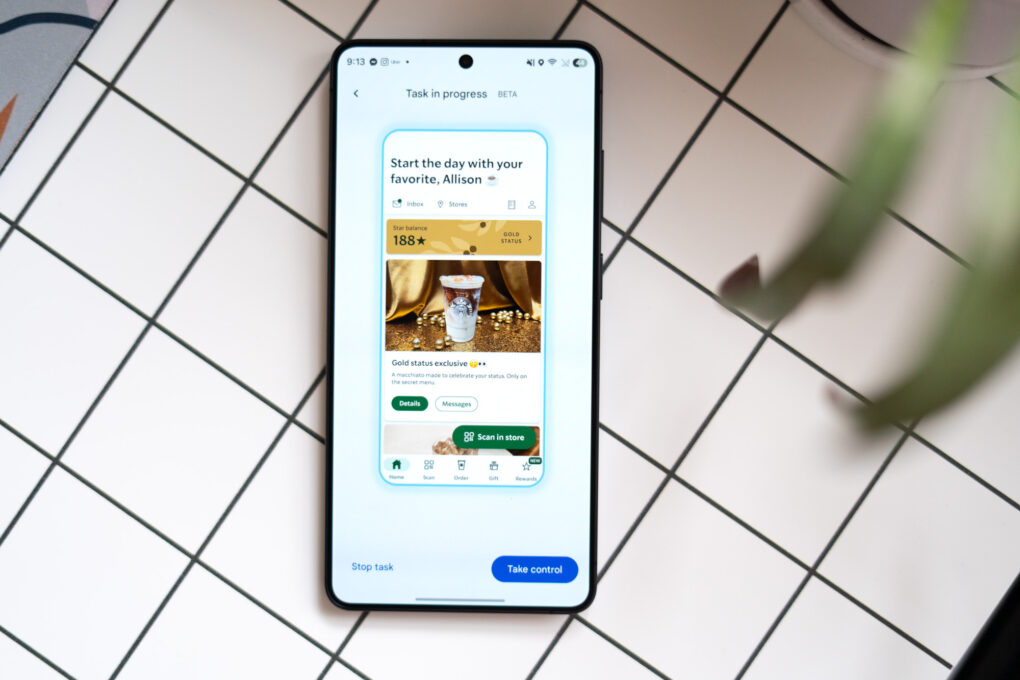

Immaginate di chiedere al vostro smartphone di ordinare un cappuccino e vederlo farlo da solo, navigando tra le app come se avesse una mente propria. Non è più fantascienza: l’automazione delle attività di Gemini è finalmente arrivata sui dispositivi Samsung Galaxy S25 Ultra, e quello che abbiamo visto nei primi test è a dir poco impressionante.

Google e Samsung hanno mantenuto la promessa fatta qualche settimana fa, introducendo una delle funzionalità più attese dell’intelligenza artificiale mobile. Si tratta di un vero salto evolutivo: per la prima volta un assistente AI può effettivamente controllare le app del nostro telefono, eseguendo compiti complessi che prima richiedevano la nostra interazione diretta.

La fase beta è appena iniziata, ma le prime impressioni sono quelle di trovarsi di fronte a una tecnologia che potrebbe cambiare radicalmente il nostro rapporto con gli smartphone. Vedere il proprio dispositivo che naviga autonomamente tra menù e opzioni è un’esperienza che oscilla tra il fascino e lo spaesamento.

Come funziona l’automazione di Gemini

Il sistema di automazione di Gemini opera attraverso quello che Google definisce una “finestra virtuale”, dove l’AI può interagire con le applicazioni proprio come farebbe un utente umano. Le prime app supportate includono i servizi di food delivery e ride-sharing, settori scelti strategicamente per la loro frequenza d’uso e la standardizzazione delle interfacce.

Il funzionamento è sorprendentemente semplice dall’esterno: basta un comando vocale o testuale come “ordina la mia pizza solita” o “prenota un taxi per l’aeroporto”, e Gemini si attiva. L’AI apre l’app necessaria, naviga tra i menù, seleziona le opzioni basandosi sulle preferenze dell’utente memorizzate in precedenza, e completa l’ordine. Tutto questo avviene in tempo reale, permettendo all’utente di osservare ogni passaggio.

La tecnologia alla base sfrutta il riconoscimento visivo avanzato e l’elaborazione del linguaggio naturale per interpretare le interfacce delle app. Gemini “legge” letteralmente lo schermo, riconosce pulsanti, campi di testo e opzioni, proprio come farebbe l’occhio umano, ma con una precisione e velocità superiori.

L’impatto sul mercato italiano e le prospettive

Per il mercato italiano, questa innovazione potrebbe avere risvolti particolarmente interessanti. Le app di food delivery come Glovo, Deliveroo e Just Eat sono parte integrante delle abitudini quotidiane di milioni di italiani, specialmente nelle grandi città. L’automazione di questi processi potrebbe rendere l’esperienza d’ordine ancora più fluida, eliminando quei piccoli attriti che spesso scoraggiano dall’utilizzo di questi servizi.

Samsung Galaxy S25 Ultra, primo dispositivo a ricevere questa funzionalità, non è ancora disponibile ufficialmente in Italia, ma secondo le indiscrezioni dovrebbe arrivare nel nostro Paese entro la primavera 2024. Il prezzo stimato si aggira intorno ai 1.400-1.500 euro, posizionandolo nella fascia premium del mercato, dove l’innovazione dell’AI automation potrebbe rappresentare un valore aggiunto significativo.

La fase beta attuale limita le funzionalità a poche app selezionate, ma Google ha già annunciato l’intenzione di espandere rapidamente il supporto. Servizi bancari, e-commerce, prenotazioni di hotel e ristoranti sono i prossimi obiettivi, aprendo scenari in cui l’assistente digitale potrebbe davvero diventare un concierge personale completo.

Sfide e considerazioni future

Naturalmente, una tecnologia così avanzata solleva anche questioni importanti. La privacy e la sicurezza dei dati sono al centro delle preoccupazioni: permettere a un’AI di accedere e controllare app contenenti informazioni sensibili richiede protocolli di sicurezza impeccabili. Google assicura che tutte le operazioni avvengono in ambienti protetti e che nessun dato personale viene conservato sui server dell’azienda.

L’aspetto più affascinante, però, riguarda l’evoluzione dell’interfaccia utente. Se le AI possono controllare le app esistenti, quanto ancora serviranno le interfacce grafiche tradizionali? Potremmo essere all’alba di una rivoluzione nell’interaction design, dove i comandi vocali e testuali sostituiscono progressivamente tap e swipe.

L’automazione di Gemini rappresenta un passo concreto verso quell’assistente AI “vero” che ci promettono da anni. Non più risposte statiche o semplici ricerche, ma azioni concrete che semplificano la vita quotidiana. Resta da vedere quanto velocemente gli utenti si abitueranno a delegare questi compiti alla macchina e, soprattutto, quanto questa tecnologia cambierà le nostre aspettative verso l’intelligenza artificiale mobile.

Fonte: The Verge