OpenAI, Musk e i Diari: Un Precedente Scomodo per il 2026

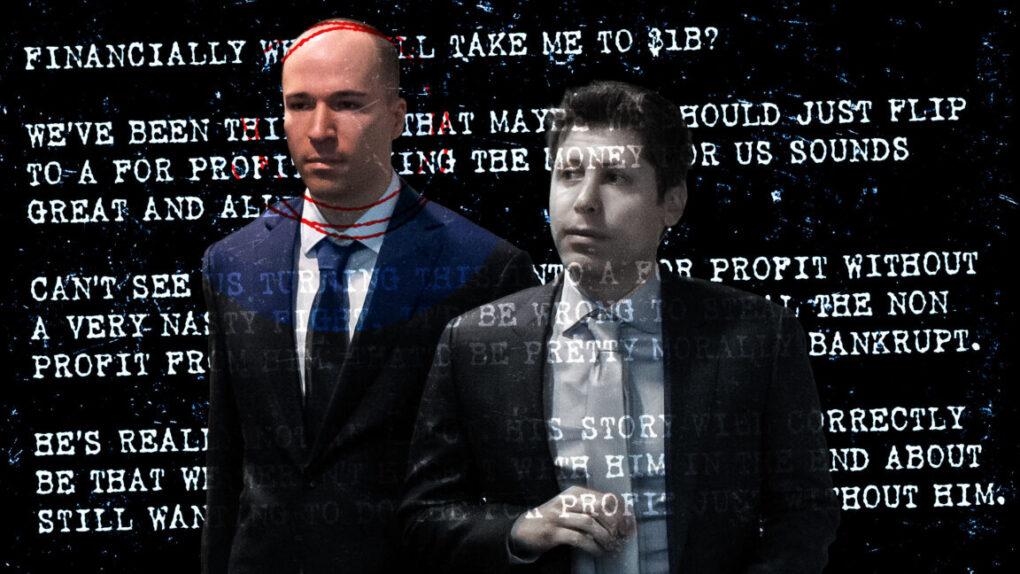

L’eco delle aule di tribunale raramente raggiunge con tanta forza il mondo tech, eppure, nel 2026, stiamo assistendo a qualcosa di unico, di profondamente inquietante. Non è un brevetto conteso, non è un’acquisizione fallita. È la privacy personale di un dirigente di spicco, Greg Brockman, presidente di OpenAI, che viene messa a nudo, pagina dopo pagina, davanti a una giuria. Il motivo? Le accuse di Elon Musk, un nome che non ha certo bisogno di presentazioni, contro quella che un tempo era la sua creatura. Un processo che, a mio parere, sta già scrivendo pagine importanti, e forse dolorose, per il futuro del settore AI.

Analisi di un Precedente Inquietante

Immaginate di dover leggere il vostro diario, le vostre riflessioni più intime, i vostri dubbi, le vostre idee ancora non formate, in un’aula di tribunale. È esattamente quello che sta vivendo Greg Brockman in questi giorni del 2026. L’uomo che ha contribuito a plasmare la più influente azienda di intelligenza artificiale, ora si trova a esporre il suo ‘flusso di coscienza’, come lui stesso lo ha definito, davanti a occhi estranei. Brockman, visibilmente a disagio, ha ammesso che è un’esperienza ‘molto dolorosa’, pur non vergognandosi di nulla. Ma il punto non è la vergogna. Il punto è la sacralità del pensiero privato, della riflessione non filtrata, che ora diventa arma in un contenzioso legale.

Questo non è un semplice log di attività o decisioni aziendali. È un viaggio nella mente di un innovatore, con tutte le sue divagazioni e le esplorazioni di ‘punti di vista alternativi’. Ed è proprio questa natura intima e non lineare a rendere la situazione così delicata. La difesa di OpenAI, e Brockman stesso, si trova a dover giustificare non solo le azioni dell’azienda, ma anche il processo di pensiero che le ha precedute. Questo solleva interrogativi pesanti: fino a che punto un’azienda o un tribunale possono scavare nella vita personale di un dirigente per comprendere le motivazioni dietro le scelte aziendali? È una linea sottile che, a mio giudizio, stiamo superando con troppa leggerezza.

Il caso Musk contro OpenAI verte sull’accusa che l’azienda abbia tradito la sua missione originaria di no-profit per il ‘bene dell’umanità’, trasformandosi in una macchina per arricchire i suoi leader, come Brockman e Sam Altman. In questo contesto, il diario diventa una sorta di prova per esplorare le intenzioni, le motivazioni e il cambiamento di rotta percepito. Ma un diario è un documento dinamico, non una dichiarazione di intenti. È un terreno fertile per interpretazioni e distorsioni, e la sua esposizione pubblica è un precedente che mi preoccupa per il futuro della privacy nel mondo tech.

Il Contesto Bollente dell’AI nel 2026

Per capire la gravità di quanto sta accadendo, dobbiamo guardare al contesto in cui ci troviamo nel 2026. L’intelligenza artificiale non è più una promessa futuristica; è una realtà pervasiva che sta ridefinendo settori interi, dalle cure mediche alla finanza, dall’intrattenimento alla sicurezza. OpenAI, con i suoi modelli avanzati, è al centro di questa rivoluzione. Nata con l’ambizione di sviluppare AGI (Artificial General Intelligence) in modo sicuro e benefico per l’umanità, ha visto un’evoluzione, o involuzione secondo alcuni, del suo modello operativo.

Elon Musk, uno dei co-fondatori originali, ha sempre sostenuto una visione di AI aperta e controllata, preoccupato dai rischi di una tecnologia così potente nelle mani sbagliate o guidata esclusivamente dal profitto. Le sue accuse non sono nuove, ma il processo legale le porta a un livello di scrutinio senza precedenti. La transizione di OpenAI da una struttura puramente no-profit a un modello ibrido, con una sezione ‘capped-profit’, ha sempre generato dibattito. Musk sostiene che questo cambiamento abbia corrotto la missione originale, focalizzando l’azienda sull’arricchimento personale dei suoi vertici piuttosto che sul bene comune. Questo è il cuore della disputa legale che sta portando a galla dettagli così personali.

Il dibattito etico sull’AI è più acceso che mai nel 2026. Chi dovrebbe controllare l’AI? Come dovremmo bilanciare innovazione e sicurezza? Profitto e responsabilità sociale? Questo processo è un microcosmo di queste tensioni globali. Mostra come le ambizioni personali e aziendali possano scontrarsi con gli ideali fondanti, e come la ricerca di trasparenza possa spingersi in territori inesplorati e potenzialmente dannosi per la libertà individuale. È una battaglia non solo legale, ma anche filosofica sul futuro della tecnologia e su chi detiene il suo potere. Il New York Times offre spesso analisi approfondite sul tema dell’AI e le sue implicazioni etiche.

Prospettive Future: Tra Privacy e Trasparenza Forzata

Questo episodio, a mio avviso, segna un momento spartiacque. La lettura di un diario personale in tribunale non è solo una curiosità legale; è un campanello d’allarme per tutti i dirigenti e innovatori nel settore tech. Quanto della loro vita, delle loro idee non ancora mature, può essere esposto al pubblico scrutinio in nome della trasparenza aziendale o di contenziosi complessi? La paura di future esposizioni potrebbe spingere a una maggiore cautela, forse a una minore spontaneità nella documentazione interna, o peggio, a una maggiore reticenza nel mettere su carta pensieri che potrebbero essere mal interpretati.

Le implicazioni per la governance aziendale sono enormi. Se le intenzioni personali dei fondatori e dirigenti diventano oggetto di indagine forense in questo modo, si crea un precedente pericoloso. Si rischia di scoraggiare la sperimentazione, il ‘thinking out loud’ che è essenziale per l’innovazione. Nessuno vuole che le proprie riflessioni private vengano usate contro di sé, specialmente quando si tratta di un’azienda che opera in un campo così sensibile come l’intelligenza artificiale.

Inoltre, questo processo intensifica il dibattito sulla natura stessa delle aziende che sviluppano AI. Devono essere entità puramente benefiche, quasi delle fondazioni, o possono operare con logiche di profitto, pur mantenendo un focus etico? La risposta è complessa, e il caso OpenAI vs Musk è un test cruciale. La fiducia del pubblico nelle grandi aziende tech è già fragile, e episodi come questo non aiutano a ricostruirla. Anzi, alimentano il sospetto che dietro le grandi promesse ci siano sempre interessi personali e finanziari. The Verge è un’ottima risorsa per seguire le evoluzioni e le controversie nel mondo tech. Wired offre spesso articoli di fondo sulla tecnologia e il suo impatto sociale.

La mia speranza è che questo caso, pur doloroso, porti a una riflessione più profonda sui limiti dell’indagine legale e sulla protezione della sfera personale anche per chi occupa posizioni di rilievo. La trasparenza è fondamentale, ma non può e non deve significare la completa spoliazione della privacy. Dove tracciamo il confine tra la ricerca della verità e l’invasione dell’intimità? È una domanda che, nel 2026, si fa sempre più pressante. Voi cosa ne pensate? È un prezzo giusto da pagare per la trasparenza, o stiamo andando troppo oltre?

Articolo originale su: Ars Technica