Quantum Computing 2026: le promesse sono reali?

Il quantum computing continua a dominare i titoli dei giornali tech, ma c’è un problema che nessuno vuole affrontare: quanta parte di quello che ci raccontano è effettivamente verificabile? Nel 2026, mentre gli investimenti in questa tecnologia raggiungono cifre astronomiche, la comunità scientifica si trova di fronte a una questione scomoda che potrebbe cambiare completamente il modo in cui valutiamo il vero potenziale dei computer quantistici.

La ricerca quantistica è affascinante, lo sappiamo. Ma la riproducibilità dei risultati—cioè la capacità di replicare gli stessi esperimenti e ottenere gli stessi risultati—rappresenta uno dei problemi più critici e meno discussi della ricerca contemporanea nel settore. E no, non è un dettaglio marginale. È il fondamento stesso della validità scientifica.

Un’analisi critica del panorama attuale rivela che molti dei risultati più celebrati del quantum computing potrebbero non essere così solidi come sembrano. Questo non significa che la tecnologia sia una bufala, ma piuttosto che dovremmo essere molto più cauti nel celebrare vittorie che potrebbero rivelarsi parziali o addirittura illusorie.

Il problema della riproducibilità nel quantum computing

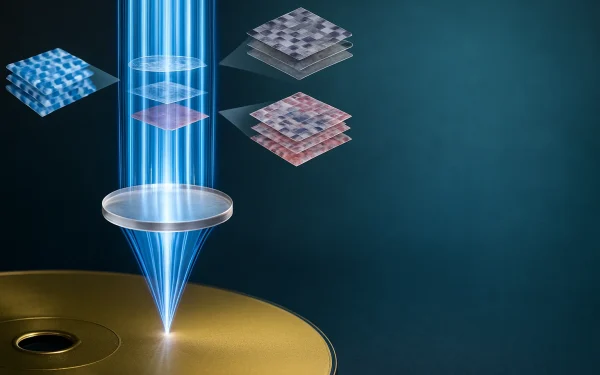

Quando si parla di fisica quantistica applicata, ci si scontra immediatamente con una realtà sgradevole: gli esperimenti sono incredibilmente difficili da replicare. A differenza della fisica classica, dove se fai cadere una palla due volte da un’altezza identica otterrai risultati identici, nel mondo quantistico le cose sono drammaticamente diverse.

I sistemi quantistici sono straordinariamente sensibili a ogni minima interferenza dall’ambiente esterno. Una variazione di temperatura di pochi millesimi di grado, un’oscillazione nel campo magnetico, persino le radiazioni cosmiche possono influenzare i risultati. Questo significa che quando un team di ricercatori annuncia un “breakthrough” quantistico, la domanda che dovremmo farci è: un altro laboratorio, con attrezzature leggermente diverse e condizioni ambientali diverse, potrebbe ottenere lo stesso risultato?

La risposta, purtroppo, è spesso no. E questo è un problema enorme, non solo per la comunità scientifica ma per tutti noi che stiamo aspettando che il quantum computing rivoluzioni il mondo. Se non riusciamo a ripetere gli esperimenti in modo coerente, come facciamo a sapere che stiamo davvero progredendo?

Le promesse del 2026 vs. la realtà dei laboratori

Parliamo di numeri. Nel 2026, il mercato globale del quantum computing vale circa 8-10 miliardi di dollari, con previsioni che lo portino a 100+ miliardi entro il 2030. Grandi aziende come IBM, Google, e Microsoft hanno investito miliardi in ricerca e sviluppo. Ma cosa abbiamo effettivamente ottenuto?

Nel 2023, Google annunciò un risultato straordinario: il suo chip “Willow” avrebbe dimostrato una “superiorità quantistica” in grado di risolvere problemi impossibili per i computer classici. Magnifico. Ma quando altri ricercatori hanno tentato di verificare indipendentemente questi risultati, le cose si sono fatte più complicate. Non perché Google mentisse, ma perché replicare esattamente le stesse condizioni è praticamente impossibile.

Questa è la natura insidiosa del problema: non è una questione di frode scientifica deliberata, ma di quella che potremmo chiamare “ottimismo metodologico”. I ricercatori, con le migliori intenzioni, tendono a interpretare i dati in modo favorevole, a ottimizzare i parametri in modo che i risultati sembrino migliori, e a non sempre comunicare apertamente i margini di errore e le limitazioni dei loro esperimenti.

Cosa significa questo per il settore e per l’Italia

In Italia, il quantum computing è ancora una frontiera poco esplorata a livello industriale, ma il nostro paese ha comunque centri di ricerca eccellenti, come l’Istituto Nazionale di Ricerca Metrologica (INRIM) di Torino e vari dipartimenti universitari. Per questi team, la questione della riproducibilità non è solo teorica—è pratica e pressante.

Se vogliamo che l’Italia non rimanga indietro nella corsa al quantum computing, abbiamo bisogno di investimenti che non vadano solo nei laboratori che fanno annunci spettacolari, ma anche in quelli che si dedicano pazientemente alla validazione e alla standardizzazione dei risultati. Abbiamo bisogno di risorse dedicate alla failure analysis, cioè all’analisi sistematica di perché gli esperimenti non si replicano, e di laboratori di riferimento che stabiliscano standard rigorosi.

Sul mercato europeo, iniziative come il Quantum Flagship europeo (finanziato da oltre 1 miliardo di euro) stanno tentando di coordinare la ricerca quantistica a livello continentale. L’obiettivo è proprio quello di superare l’isolamento dei singoli team e di stabilire standard comuni di riproducibilità. È un approccio intelligente, anche se lento.

Il futuro: scetticismo costruttivo

Non stiamo suggerendo di abbandonare il quantum computing. Sarebbe ridicolo. La tecnologia ha potenziale genuino, soprattutto in settori come la crittografia, l’ottimizzazione di processi complessi e la scoperta di nuovi materiali. Ma nel 2026, mentre il hype continua a montare, abbiamo il dovere di essere più critici e di richiedere standard più rigorosi.

Questo significa porre domande difficili: quando un laboratorio annuncia un risultato quantistico, quale percentuale di altri laboratori riesce a replicarlo? Quali sono i margini di errore reali? Quali sono le assunzioni nascoste negli esperimenti? Fino a quando queste domande non avranno risposte chiare e condivise, dovremo accettare che stiamo ancora nei primi capitoli di una storia che potrebbe durare ancora molti anni.

Il quantum computing non è una truffa. Ma è nemmeno il miracolo tecnologico che talvolta viene dipinto. È una sfida scientifica affascinante e complessa che richiede pazienza, rigore e, soprattutto, onestà intellettuale da parte di chi la affronta.

Fonte: Tom’s Hardware Italia